La visibilidad en IA empieza antes de la búsqueda y se gana con citaciones

La influencia fuera del buscador define qué AIs nos eligen: Google sigue dominando búsquedas, pero la atribución se mueve a etapas previas de descubrimiento.

Esto va de una cosa concreta: Google sigue acaparando el 73% del tráfico de búsqueda (desktop + mobile), pero la demanda que alimenta esa búsqueda se fabrica antes, en noticias, comunidades y plataformas que las AIs usan como referencia (SparkToro, marzo 2026).

¿Qué cambió en 2026 y por qué importa?

La novedad no es que exista IA; es que la IA actúa como agregador y citador: selecciona de entidades conocidas, no descubre marcas nuevas. Lo dice la evidencia: un estudio de Siege Media citado en la cobertura de la industria analizó más de 7.2 millones de sesiones y vinculó citaciones sostenidas con investigación original y voz experta (Siege Media, estudio de 7.2M sesiones, citado en Search Engine Land). Además, eMarketer muestra que entre el 40% y el 60% de las fuentes citadas por respuestas en Google AI Mode y ChatGPT cambian mes a mes, es decir, la visibilidad en IA es volátil y dependiente de señales externas (eMarketer, variación mensual 40–60%).

Ese combo —volatilidad más dependencia de señales fuera del buscador— redefine prioridades técnicas y de contenido. Herramientas como Jasper o Google Vids cambian quién puede producir video o paquetes multimodales, pero lo que decide si una IA nos cita no es la producción técnica sino la existencia previa de entidad: referencias, datos abiertos, y presencia en nodos de confianza (Search Engine Land, 4/5/2026).

¿Cómo impacta esto en el mercado argentino?

La lógica es la misma acá: si la IA importa, importa qué hablan de nosotros en los espacios donde la IA pesca. Plataformas comunitarias alimentan esos espacios —por ejemplo, Reddit genera conversación diaria a gran escala (citado en Search Engine Land como 100 millones de usuarios diarios según eMarketer/Max Willens)— y YouTube sigue siendo un repositorio clave para contenido que luego las AIs resumen. Para una marca argentina eso significa dos cosas prácticas: primero, invertir en presencia verificable en fuentes de referencia (prensa, Wikipedia, YouTube, comunidades) y, segundo, transformar investigación propia en datos publicables y estructurados que los fetchers puedan citar.

En la práctica local, la democratización de video (Google Vids) baja la barrera de producción; no se trata de gastar más guita en producción cara sino de producir piezas con señal de entidad: metadatos, descripciones estructuradas y datos abiertos que permitan atribución. Si no hay datos públicas y citables, el volumen de posts no alcanza.

Qué hay que hacer ya: prioridades, auditoría y presupuesto

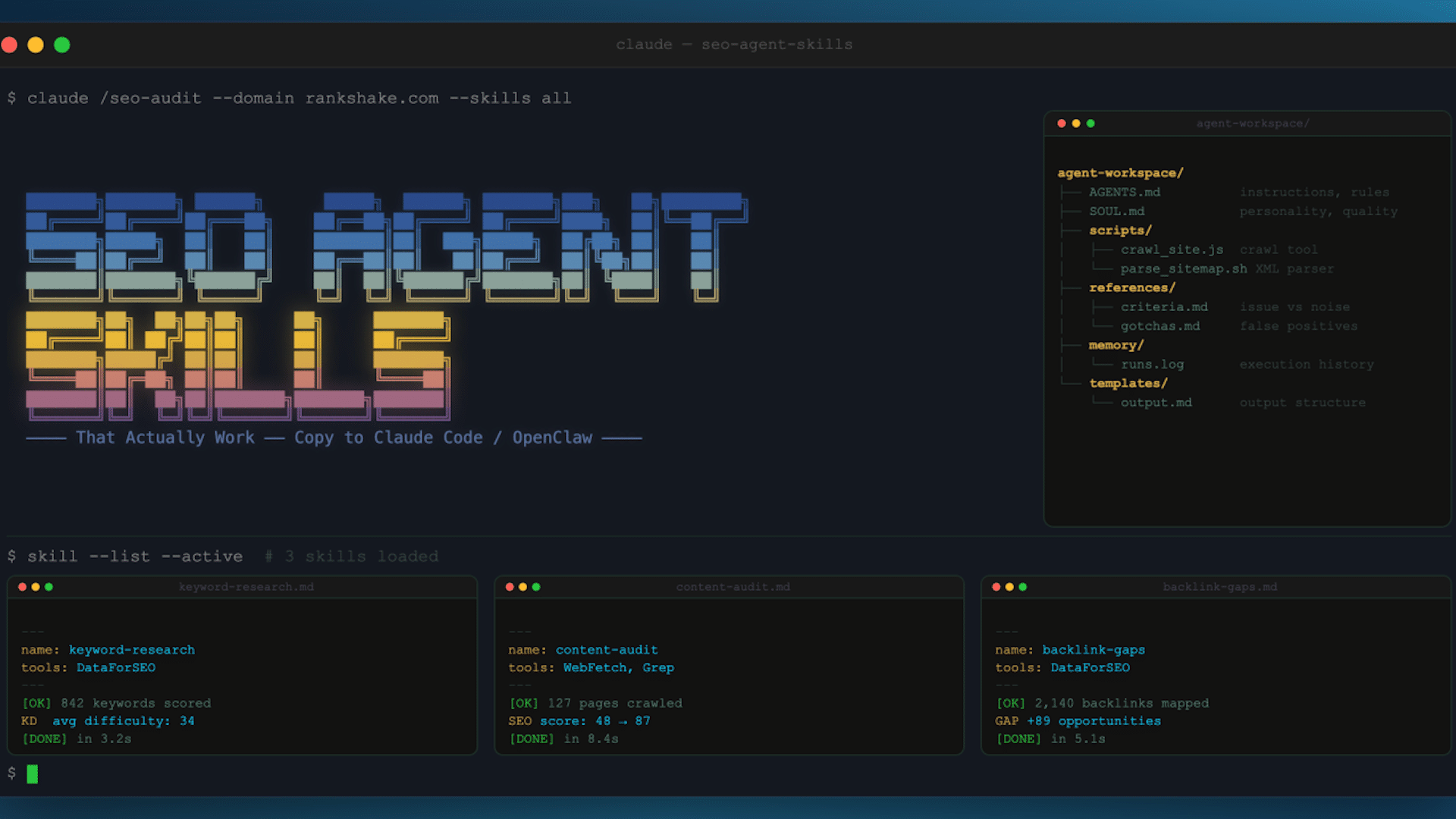

No hay atajos técnicos para la falta de señal. La primera medida es auditar visibilidad en los modelos reales: consultá ChatGPT, Claude, Gemini, Copilot y Perplexity con prompts de usuarios reales; anotá quién aparece y qué fuentes se citan (Search Engine Land, 4/5/2026). Segundo, liberá investigación única: convertir white papers bloqueados en datasets crawlables aumenta las probabilidades de atribución por AI. Tercero, decisión deliberada de robots.txt: permitir OAI-SearchBot para aparecer en citas en tiempo real y optar por bloquear GPTBot para limitar entrenamiento son elecciones estratégicas con consecuencias claras (Search Engine Land).

En cuanto a asignación, el marco recomendado por eMarketer reparte 40% a fundamentos SEO, 25% a digital PR, 20% a datos y reporting, 10% a capacitación y 5% a experimentación. Esa distribución prioriza señales y gobernanza de datos antes que escalar producción con IA sin control de atribución (eMarketer, recomendación de asignación porcentual).

Conclusión: la ventaja es para quien ya laburó en serio

La infraestructura de IA de 2026 premia el trabajo de años: datos originales, reputación y presencia en nodos de referencia. Si veníamos priorizando identidad, gobernanza de datos y atribución limpia, estamos en ventaja; si nuestra respuesta fue solo producir más artículos con IA, lo más probable es que compitamos por volumen que no se cita. La recomendación es clara y coherente con nuestra postura: validar identidad, asegurar atribución limpia y retener propiedad de datos antes de escalar automatismos o contenido generado por IA (posicion_resumen). En el corto plazo puede no verse en un dashboard de vanity metrics, pero en el tiempo estas señales son las que convierten visitas en ingresos medibles.