IA acelera análisis SEO, pero requiere validación y propiedad de datos

Un flujo con Semrush + asistentes de IA reduce horas a minutos, pero hay errores sistemáticos que exigen controles humanos y gobernanza de datos.

Se puede producir en 20 minutos un análisis de competencia SEO que antes requería una tarde, pero cerca del 15% de las clasificaciones automáticas requieren corrección manual, según Search Engine Land (22/4/2026).

¿Qué propone el método y por qué importa?

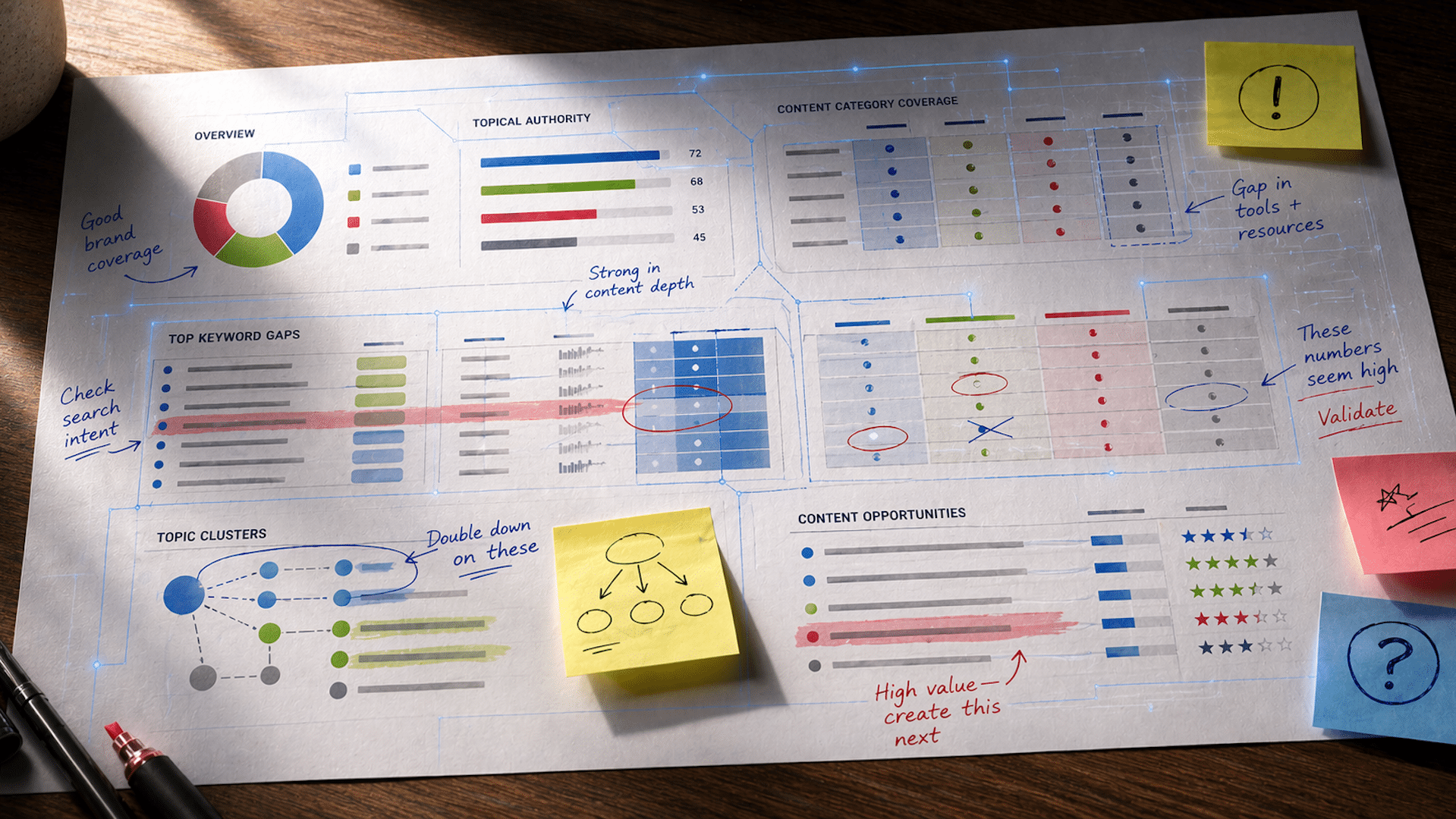

El flujo es directo: exportar datos de Semrush (Pages y Positions), pasar esos CSV a un asistente de IA y obtener en minutos una taxonomía, clusters y una tabla de gaps priorizados. En el caso documentado, una sola guía atrajo 7.336 visitas y la mejor página de producto 5.021; el total estimado del top 100 de Site Y fue 35.681 visitas (Search Engine Land, 22/4/2026). El ahorro de tiempo es real, pero los riesgos también: la IA clasificó erróneamente páginas por estructura de URL y omitió matices de intención. Además, el análisis detectó 217 keywords faltantes con volumen combinado ~49.700 búsquedas/mes y 106 “weak” con ~33.650 búsquedas/mes (Search Engine Land, 22/4/2026). Eso convierte a la IA en una herramienta de cribado, no en un decisor estratégico.

¿Cómo validamos esos outputs en la práctica?

Primero: partir siempre de exportaciones de la herramienta, no pedirle a la IA estimaciones que ella inventará. Segundo: spot-check del 10–15% de las clasificaciones automatizadas; en el caso citado, ese chequeo corrigió ~15% de los errores iniciales (Search Engine Land, 22/4/2026). Tercero: separar oportunidades por intención; si más del 60% del tráfico de un cluster es informacional, marcarlo como “constructo de autoridad, no conversión directa”. Cuarto: para las 5–10 keywords prioritarias hacer un chequeo manual del SERP: si el resultado está dominado por shopping packs, videos o carouseles, la ganancia de subir en posición orgánica será limitada. Y quinto: validar fechas de exportación — si los datos tienen más de 90 días hay que refrescarlos antes de tomar decisiones tácticas.

¿Conviene usar esto ya en nuestras campañas en Argentina?

Sí, con condiciones. La potencia operacional de Semrush + asistentes de IA sirve como laboratorio para mapear brechas y acelerar briefs. Pero no conviene escalar contenidos o automatismos generados por IA sin gobernanza: propiedad de datos, trazabilidad de cambios, y atribución limpia deben estar resueltas antes de invertir pauta o recursos de producción. Además, hay señales de autoridad y backlinks que la IA no replica: en el caso analizado, Competitor B tenía 199 backlinks con autoridad promedio 1.1 y Competitor A 128 backlinks con promedio 3.1, lo que sugiere que las posiciones se sostenían más por relevancia on‑page que por link equity (Search Engine Land, 22/4/2026). Para mercados locales como Argentina, la recomendación es replicar el flujo con exportaciones locales y validar que los clusters alineen con lo que verdaderamente vendemos: sin esa validación, la IA puede sugerir perseguir volumen ajeno.

Recomendaciones prácticas: qué hacer la semana que viene

- Exportar Pages y Positions (top 50–100) y un Screaming Frog para contexto estructural. 2) Ejecutar el clustering con la IA para ahorrar tiempo; luego spot-check del 10–15% y corregir. 3) Separar gaps en tiers por intención y negocio; en el ejemplo hubo 17 “close wins” dentro de 106 weak keywords que podían optimizarse sin crear contenido nuevo (Search Engine Land, 22/4/2026). 4) Hacer un chequeo de canibalización antes de crear páginas nuevas. 5) Medir con atribución clara y tests incrementales: optimizar páginas existentes y medir lift antes de lanzar grandes sprins de contenido o compra de tráfico. En resumen: usar IA para acelerar laburo operativo, pero sostener la toma estratégica con datos propios, controles humanos y objetivos de negocio claros.